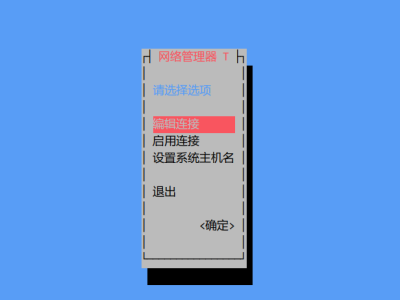

Linux资产图形化配置网络之nmtui指令若Linux系统精简安装,默认不带nmtui命令单独可进行yum安装# yum install NetworkManager-tui #nmtui安装命令# nmtui #打开图形化的网络配置如下图所示nmtui打开网络编辑器,按需进行网络编辑、启用操作以编辑连接为例,可以选择需要修改的网卡进行回车即可进行编辑逻辑与命令编辑一致,nmtui 图形化操作相比编辑网卡配置文件及命令行方式操作难度更

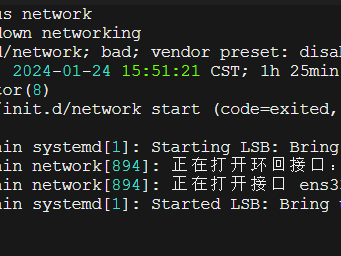

前言如果你正在使用CentOS系统,并且想要深入了解网络管理和配置,那么本文肯定适合你!在这篇文章中,作者深入探讨了CentOS中的两种网络管理方式:network服务和NetworkManager。通过详实的讲解和实用的示例,你将会学习到如何使用这两种工具来管理网络接口、配置IP地址、网关和DNS等网络参数。无论你是服务器管理员、运维工程师还是普通用户,本文都可以为你提供实用的知识和技巧,助你轻松应对各种网络配置需求。现在就点击阅读,开启你的网络管理之旅吧network与NetworkMana

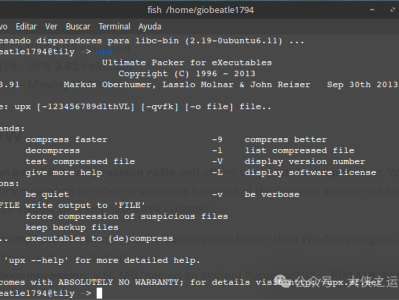

工具简介UPX(Ultimate Packer for eXecutables)是一款开源的高性能可执行文件压缩工具,自1998年发布以来已成为开发者和安全人员的必备利器。它通过智能算法将程序体积缩减50%-70%,且完全保留原始功能,支持Windows PE、Linux ELF、macOS Mach-O等20+可执行格式。作为GPLv2+协议下的开源项目,UPX既能免费用于商业软件,也可深度定制扩展。核心特点1. 极致的压缩效率• 超强压缩比:平均缩减60%体积,优于Zi

软件介绍AutoCAD 2022提供丰富的工具集,通过 AutoCAD 2022 体验增强的自动化功能,AutoCAD2022 软件包括行业专用工具组合、改进的跨平台和 Autodesk 产品的互联体验,以及诸如计数等全新的自动化操作功能。广泛应用于机械设计、工业制图、工程制图、土木建筑、装饰装潢、服装加工等多个行业领域。图片安装教程我以CAD2022版本举个例子:序列号356-72378422、666-69696969、667-98989898、400-4545454501.下载压缩包后,鼠标

类型:动画片剧情 喜剧 动画 奇幻 动画片 地区:中国大陆 年份:2025 剧情简介《哪吒之魔童闹海》是一部评分为5.0 的动画片影视作品,主要演员有:吕艳婷 囧森瑟夫 瀚墨 陈浩 绿绮 张珈铭 杨卫 雨辰 周泳汐 韩雨泽 南屿 零柒 良生 《哪吒之魔童闹海》剧情简介:天劫之后,哪吒、敖丙

TORRENTKITTY - FREE TORRENT TO MAGNET LINK CONVERSION

Welcome to TorrentKitty! Your go-to torrent search engine for discovering a vast collection of magnet links and torrent files across the web. Wheth

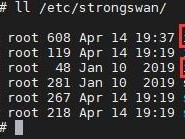

strongSwan是一个开源的基于IPsec的VPN解决方案,经过前面几篇文章的铺垫,今天终于可以测试strongSwan和华三设备的对接情况了。strongSwan的默认安装路径是/etc/strongswan/,这里面比较重要的就是ipsec.conf和ipsec.secrets这两个配置文件了。这两个文件的配置已经指导过了,有需要的小伙伴可以参考(strongSwan之ipsec.conf配置手册)和(strongSwan之ipsec.secrets配置手册)。对组网拓扑稍作调整,用一台

我常常见到我的客户使用虚拟机的CPU和内存的热添加功能,这确实是个了不起的功能,在不关虚拟机的情况下,就可以马上为虚拟机增加CPU资源,谁不喜欢呢?为什么VMware不把这个功能做出默认的选项?因为这样做有个很大的弊端。 参考下面两个知识库内容:https://knowledge.broadcom.com/external/article?legacyId=2040375https://knowled

开源免费vρν平台Anylink部署使用——具备图形化管理界面AnyLink 基于 ietf-openconnect 协议开发,并且借鉴了 ocserv 的开发思路,使其可以同时兼容 AnyConnect 客户端。AnyLink 使用 TLS/DTLS 进行数据加密,因此需要 RSA 或 ECC 证书,可以使用私有自签证书,可以通过 Let's Encrypt 和 TrustAsia 申请免费的 SSL 证书。项目地址:github地址:https://github.com/bjdgyc

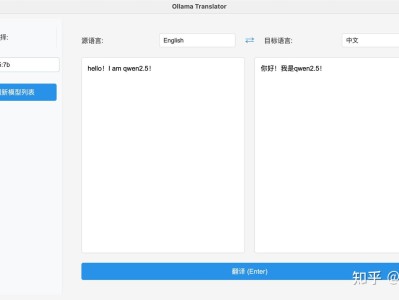

【AI大模型】本地部署Ollama+翻译服务还在因为Google翻译经常死机而感到烦恼吗,还在因为一些软件大段文字翻译拉垮而感到烦躁吗,还在因为一些ai翻译服务付费而感到无力吗!非常浮夸的开头hhh这些天的deepseek杀疯了,到处都是关于deepseek的新闻。deepseek全网参与度如此之高,有一个很大的原因就是他开源了从1.5B-671B的各种大小的量化蒸馏模型,掀起了一阵本地部署大模型的浪潮。(谁不想要一个自己的贾维斯呢~)(虽然现在本地模型离贾维斯还挺远的)这篇文章就是记录一下我的

【AI大模型】Open-WebUI本地大模型+联网搜索部署上篇记录的是ollama本地部署大模型实现翻译的简易版攻略,用的ollama的后台,然后加上自己攒出来的ui界面实现。上篇链接如下https://www.hqyman.cn/post/9066.html这篇记录一下一个非常强大的开源工具Open-webui的部署,通过这个开源软件实现和本地大模型的对话,进一步的还会提到如何设置本地知识库,以及如何设置联网搜索功能。Open-webui简介Open-WebUI是一个可扩展、功能丰富且用户友好

背景KHMD 是一款完全免费、没有任何限制的音乐软件,支持无损音质的收听和下载。之前的版本失效了,现在又回来了!今日分享老牌音乐神器又全面升级可以使用了:.............................................................................................................................................................................